摘要

【学习笔记】

机器学习的基础知识点

机器学习 (Machine Learning)

机器学习模型

有监督(supervised)模型

- 数据样本(sample)带有目标属性 y

- 即标记数据(labeled data)

- 通过学习使函数 F(x) ≈ y

半监督(semi-supervised)学习

将有监督和无监督学习结合在一个只有少量标记的数据集中,更好地利用数据集

- 例:预测图像分类,但只对图像的10%进行了标记。更好的策略是首先将图像聚类成组(无监督学习),然后对每个组分别应用有监督的学习算法。第一阶段的无监督学习可以帮助我们缩小学习的范围,第二阶段的有监督学习可以获得更好的精度。

无监督(unsupervised)模型

聚类(clustering)

- 根据数据集样本之间的相似性,将样本聚集成组

关联(association)

- 发现样本属性之间隐藏的关联模式

分类(classification)模型

- 输出为离散值(discrete values)

- 有时使用逻辑回归(logistic regression)模型将连续概率值作为输出,但用于解决分类问题

回归(regression)模型

- 输出为连续值(continuous values)

- 输入为特征(features)元组,有时候需要将非数字特征转换(transform)为数字特征

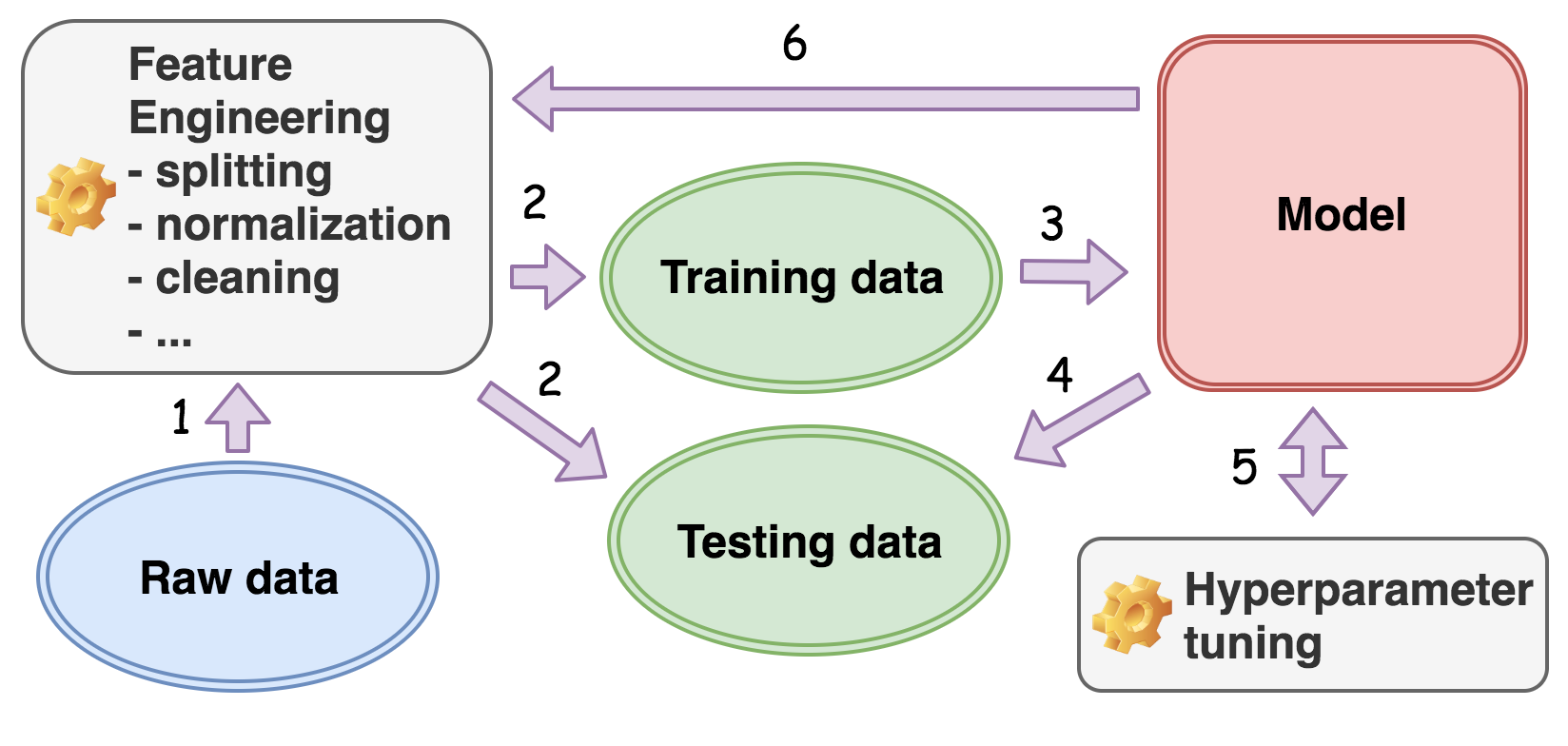

机器学习工作流(workflow)

以数据为中心

1 确定问题类型,有监督还是无监督问题

- 1.1 对于有监督的机器学习算法,进一步确定模型类型,分类或回归

2 执行特征工程(feature engineering)

- 2.1 将数据分成训练集和测试集

- 2.2 填充不完整的原始数据集缺失值(如使用平均值等)

- 2.3 将非数字的分类属性编码为数值

3 训练(training)过程

- 输入训练数据训练模型

4 测试(testing)过程

- 训练结束后使用测试数据对模型进行测试

5 超参数调优(hyper-parameter tuning)

- 迭代训练,并不断调整模型参数

- 调优的参数是我们与模型交互的最外层接口,而这最终会对模型的底层参数造成影响

数据集(data set)

训练模型的表现由数据质量决定

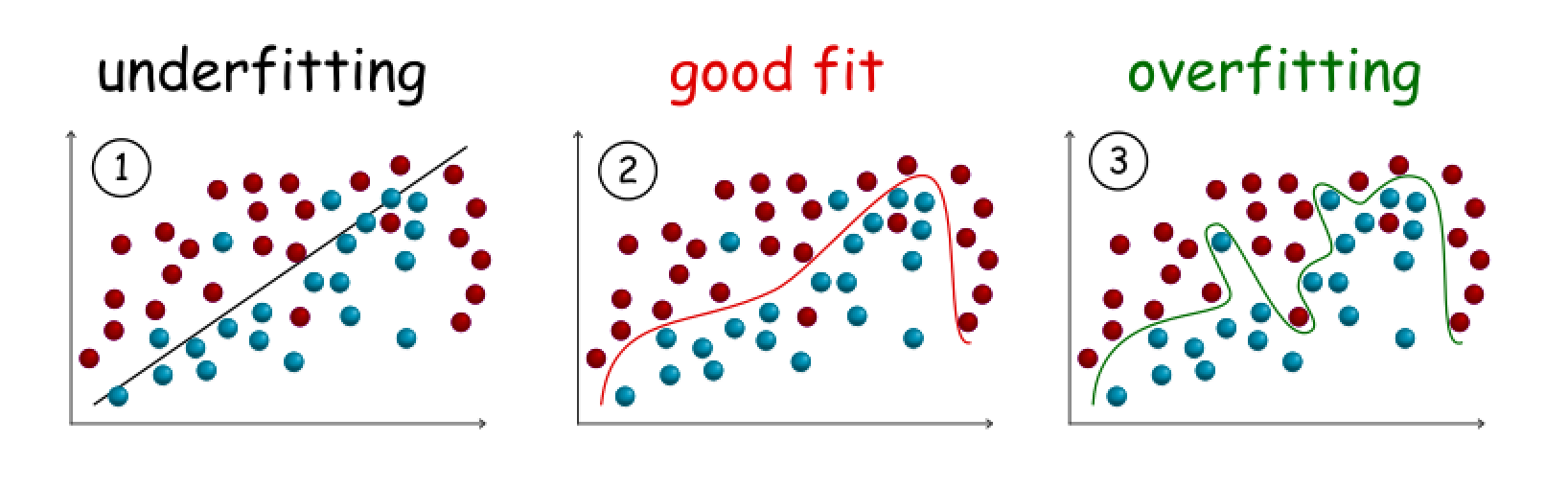

有监督学习两种不好的拟合情况

欠拟合(underfitting)

- 描述:不能很好地拟合训练数据的模型,即显著偏离真实值的模型

- 原因:模型对数据而言过于简化,无法捕获数据中隐藏的关系

- 解决:选择一种能够从训练数据集生成更复杂模型的替代算法

过拟合(overfitting)

- 描述:与训练数据拟合较好的模型,即误差很小或没有误差,但不能很好地推广到不可见数据

- 原因:模型过于复杂,陷入噪音和误差的陷阱

- 解决:用生成更简单模型的算法;或使用原始算法,但在算法中添加正则化(regularization)项

有监督学习算法的重要度量——泛化

- 衡量从训练数据导出的模型对不可见数据的期望属性的预测能力

与训练数据相拟合的模型的泛化能力未必就好

- 1). 训练数据只是我们从现实世界中收集的样本,只代表了现实的一部分。

- 2). 我们收集的数据不可避免地含有噪音和误差。

适用机器学习的场景与使用目的

适用场景与使用目的

- 问题复杂,传统方法难以解决,最好的机器学习方法可以找到解决方案

- 环境有波动,使用机器学习算法可以适应新数据

- 需要进行大量手工调整或需要拥有长串规则才能解决的问题,使用机器学习算法可以简化代码、提高性能